FlashToken

面向低延迟 LLM 系统的 Tokenizer 端前缀缓存,在可复用提示上可达 27x-37x 提速。

FlashToken 在不改变模型权重的前提下加速 tokenization:当多次请求共享长前缀(system prompt、模板、对话历史)时,避免重复编码同一段文本。

亮点

- 零错配: 与

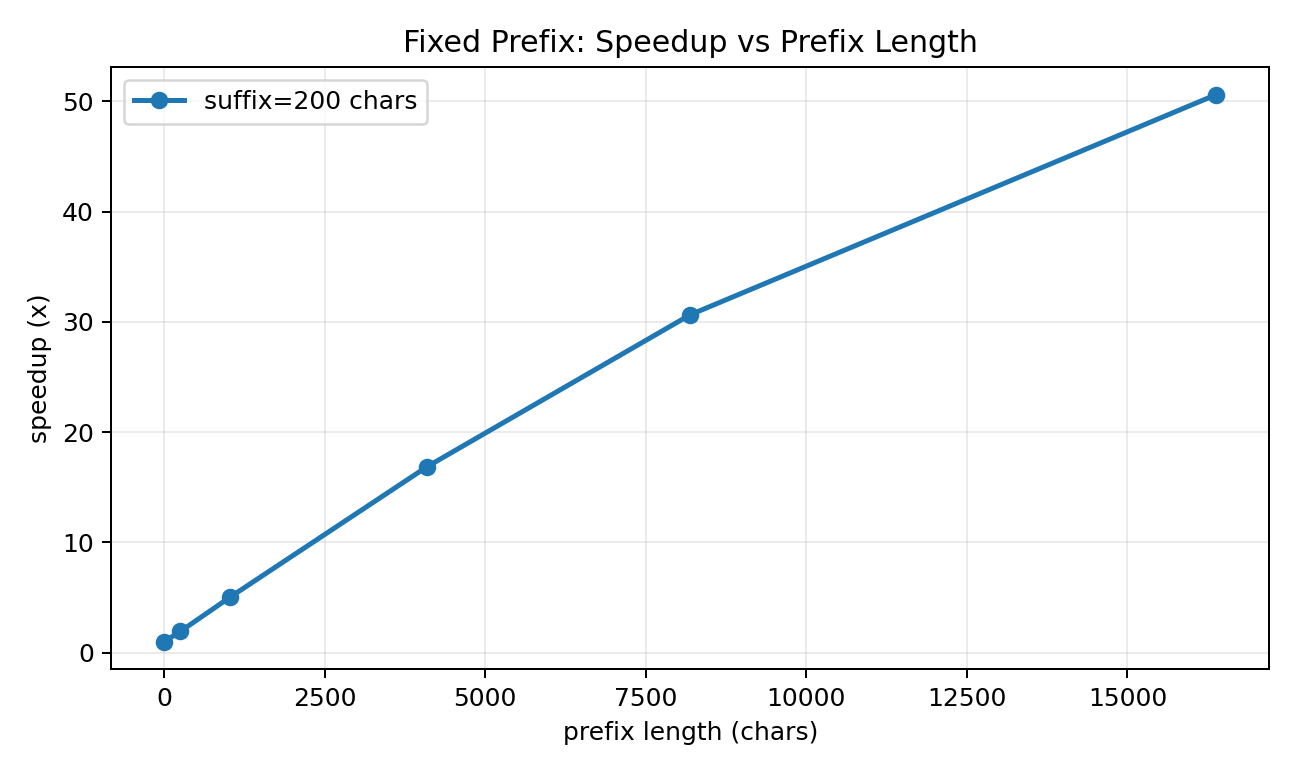

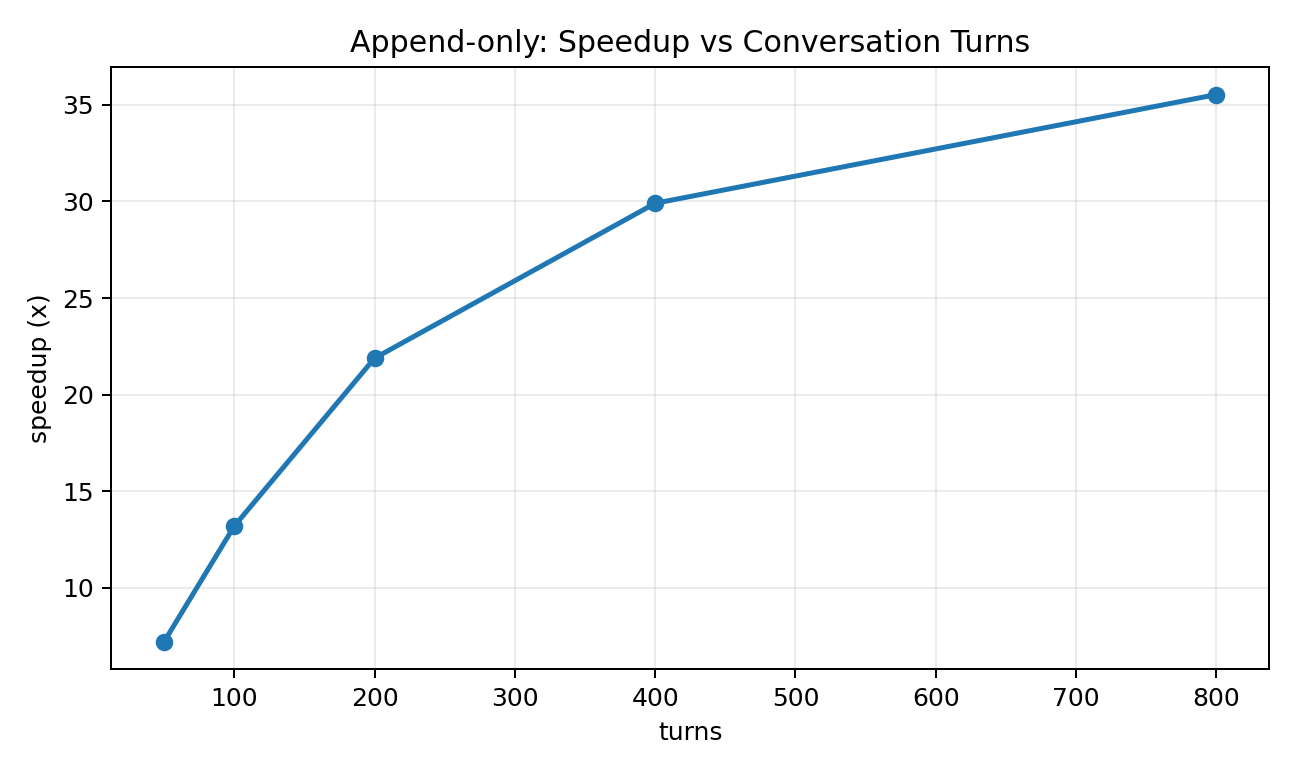

tiktoken.encode_ordinarytoken-by-token 一致(mismatches = 0)。 - 大幅提速: 在“长前缀复用 / append-only 对话”场景达到 27×–37× speedup。

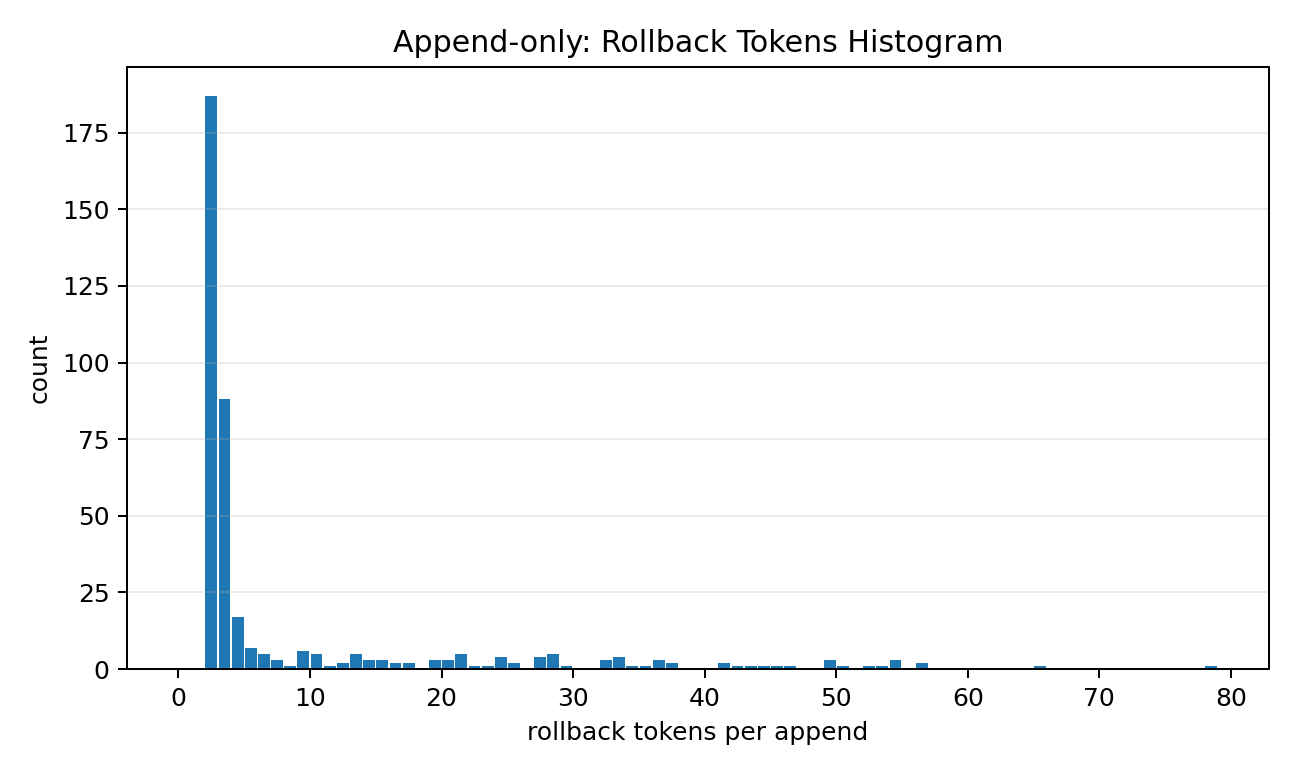

- 两种策略: 固定前缀复用 + append-only 增量编码(更贴合 KV-cache 工作流)。

快速开始

import tiktoken

from flashtoken import FixedPrefixTokenCache

enc = tiktoken.get_encoding("cl100k_base")

cache = FixedPrefixTokenCache(enc, prefix="SYSTEM: ... 很长 ...\n")

tokens = cache.encode_ordinary("User: hello\n")