AI 系统研究者

我在做的是能长期运行、可检查、可复现、且足够快的 Agent 系统。

我的工作介于研究与系统工程之间:长时运行的编码 harness、可监督执行平台、Rust 原生多 Agent 编排, 以及面向推理与 RAG 的效率和可靠性工具。

当前重点

- 带有显式规划、评估闭环和恢复能力的长时运行编码 Agent

- 面向真实工作区、可监督、可审计的 Agent 执行平台

- Rust 原生、类型化、多 Agent 工作流编排系统

研究重点

我在优化什么

长时运行 Agent 系统

把 planning、generation、evaluation、checkpointing 做成运行时的一等公民,而不是堆砌 prompt 技巧。

可靠的执行基础设施

让 Agent 能在真实项目目录里持续工作,留下可审计痕迹,并在人工监督下稳定推进任务。

推理与 RAG 效率

关注 tokenization、核函数、reranking 稳定性和证据治理,让大模型系统更快、更稳、更不脆弱。

重点项目

本次重点展示的三个近期项目

它们分别对应长时运行开发 harness、可监督执行平台和 Rust 原生多 Agent 编排。

codex-long-running-harness

面向长时运行应用开发的 Codex-first harness,强调 sprint 规划、评估闭环和 benchmark 快照。

- 把开放式应用开发拆成可检查的 sprint。

- 不走单次 prompting,而是显式规划器、生成器、评估器协同。

- 保存 benchmark 快照,让进展可度量、可复现。

TaskCaptain

面向真实工作区的可监督 Agent 执行平台,强调任务状态透明、运行过程可见、控制权本地优先。

- 让 Agent 在真实项目工作区中运行,并保留清晰任务状态。

- 显式管理日志、工件和配置边界。

- 把 AI 定位为可监督执行者,而不是仅会聊天的助手。

研究工程档案

支撑能力的既有研究工程作品

OverSearchGuard

面向 Agentic RAG 的冲突感知证据裁剪层,兼顾鲁棒性与 token 成本。

- 在生成前限制重复且低质量的证据刷屏。

- 无需微调即可建模可靠度与新鲜度。

- 同时提升准确率并显著压缩 token 开销。

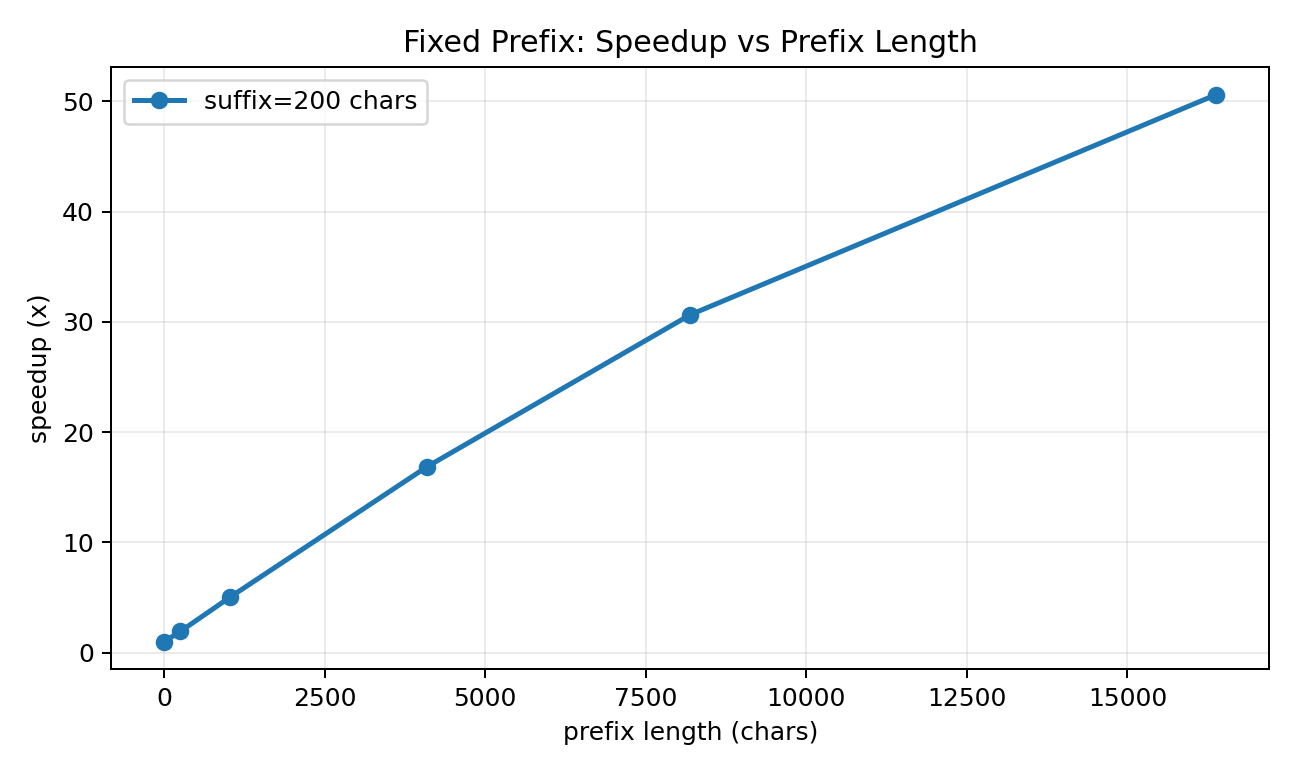

FlashToken

面向低延迟 LLM 系统的 Tokenizer 端前缀缓存,在可复用提示上可达 27x-37x 提速。

- 在不改模型权重的前提下复用长提示前缀。

- 同时支持固定前缀和 append-only 对话流程。

- 保持 token 完全一致的同时获得大幅提速。

OrderGuard

通过置换边缘化降低 LLM 判题、重排和工具选择对候选顺序的敏感性。

- 在推理期把候选顺序视作干扰变量处理。

- 结合低方差置换调度与自适应 early-stop。

- 在 Qwen3 评测套件上带来稳定准确率增益。

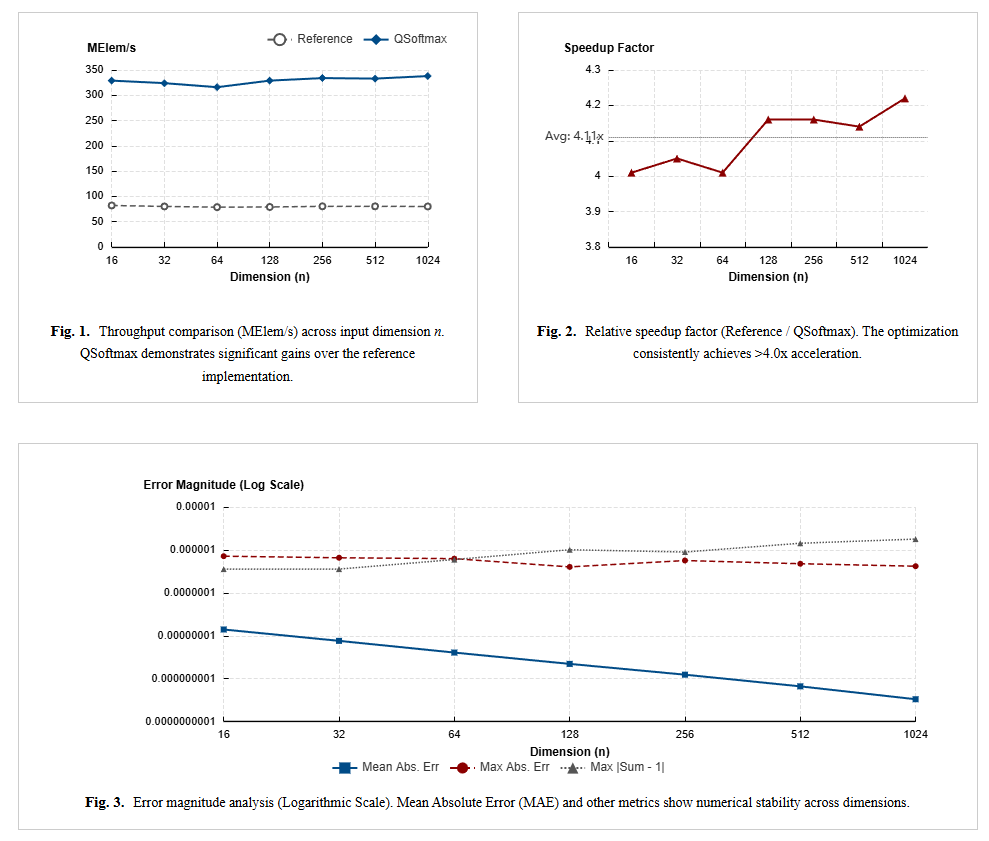

Turbo-Softmax

面向资源受限 CPU 与 MCU 的高精度快速 Softmax C 内核实现。

- 使用面向 IEEE-754 的实现技巧适配通用 MCU。

- 在数值精度与吞吐之间做平衡优化。

- 体现了进入 Agent 系统之前的底层性能工程兴趣。

教育背景

教育经历

剑桥大学

预期 2026–2027 · 联合培养访问学生 · CSC 全额奖学金

电子科技大学

2024–2027 · 电子科学与技术硕士 · GPA 3.86/4.0 · A+

电子科技大学

2020–2024 · 电子科学与技术学士 · GPA 3.82/4.0 · A+

荣誉

荣誉与研究方向

IEEEXtreme

24 小时编程竞赛全球前 5%,2021。

荣誉学位

学院 Top 2,优秀毕业生。

研究主线

Agent 系统、评估基础设施、推理优化与可靠性导向的 RAG。